Chaque question posée à une intelligence artificielle a un coût pour la planète plus élevée qu’une simple requête sur un moteur de recherche. Or, si ChatGPT est la plus connue des IA génératives à l’heure actuelle, des alternatives moins gourmandes en énergie existent, dont Bloom (BigScience Large Open-science Open-access Multilingual Language Model).

« On en parle peu mais la France bâtit son propre ChatGPT depuis 2021. Bloom est un projet ouvert et participatif piloté par Hugging Face, une start-up fondée par trois Français à New-York », explique Laurence Devillers, professeure d’intelligence artificielle à la Sorbonne et chercheuse au CNRS. Ce modèle open source, disponible en 59 langues, a été conçu et entraîné par plus de 1.000 ingénieur·e·s, avec le soutien du CNRS, du ministère français de l’enseignement supérieur et de la recherche ainsi que d’entreprises telles que Thalès, Airbus ou Orange Labs.

Ce chatbot s’entraîne sur le supercalculateur le plus puissant d’Europe, Jean-Zay, basé à Saclay. « On a utilisé un réseau de neurones de 176 milliards de paramètres », précise Pierre-François Lavallée, le directeur de l’Idris (Institut du développement et des ressources en informatique scientifique, qui dépend du CNRS), à Saclay.

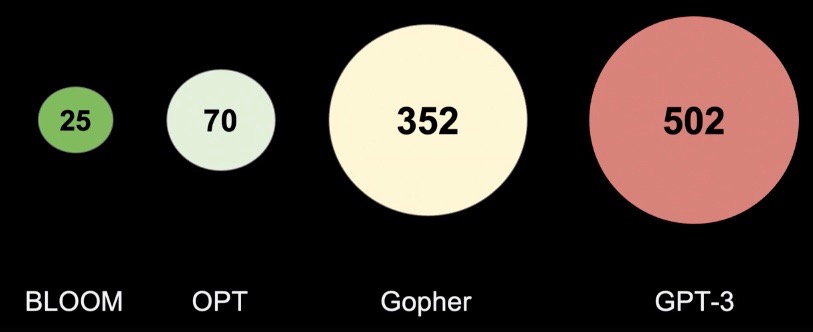

« Bloom mise sur l’éthique, la transparence et le consentement », d’après la chercheuse québécoise Sasha Luccioni, associée à Hugging Face. « L’entrainement de Bloom utilise 20 fois moins d’énergie que ChatGPT », affirme-t-elle (cf. graphe d’illustration). La chercheuse a notamment contribué à élaborer une calculette de l’impact carbone des outils d’intelligence artificielle générative, appelé CodeCarbon. Elle a également étudié l’impact des modèles d’IA sur les pratiques discriminatoires et sur la propriété intellectuelle pour aider les entreprises à choisir un modèle d’IA en connaissance de cause.

« Lorsqu’elle est opaque, l’intelligence artificielle dispose d’un gros pouvoir de manipulation », rappelle Laurence Devillers. Il faudrait d’ailleurs plutôt parler de ‘capacité analytique’ que d’intelligence, selon elle. « Il faut rester vigilant en veillant à ce que les développements de l’IA respectent une certaine éthique ». Elle regrette que la transparence ne soit pas une priorité chez la plupart des multinationales du numérique et rappelle que deux chercheuses de Google, Timnit Gebru et Margaret Mitchell, ont été licenciées pour avoir exposé des failles du système IA de leur entreprise.